David Tudor war ein Pianist und Komponist experimenteller Musik, der Mitte der 1960er Jahre Pionierarbeit im Bereich der elektronischen Live-Musik leistete. Er spielte viele frühe Werke von John Cage, Christian Wolff, Morton Feldman, Earle Brown, Karlheinz Stockhausen, Stefan Wolpe und La Monte Young. Viele dieser Komponisten schrieben Stücke ausdrücklich für Tudor und er arbeitete eng mit Cage zusammen, um viele Kompositionen zu entwickeln. Er wurde der Pianist der Merce Cunningham Dance Company und er und John Cage tourten in den 1950er und 1960er Jahren mit Konzerten von Cages Werken.

Neural Synthesis

1989 lernte er nach einer Show in Berkeley den Techniker und Designer Forrest Warthman kennen, der ihn auf die Idee brachte, analoge neuronale Netze zu verwenden, um seine gesamte komplexe Live-Elektronik in einen Computer zu integrieren. Ein Ergebnis ist die CD „Neural Synthesis“ (Track 6 im Video), zu der Warthman in den Liner Notes schreibt:

die Rolle des Lernenden, des Mustererkenners und des Antwortenden wird von David übernommen, der selbst ein weitaus komplexeres neuronales Netzwerk ist als der Chip

“

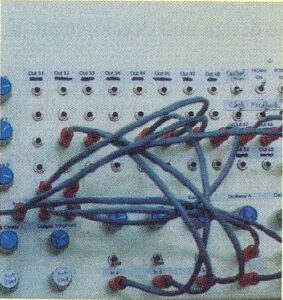

Das Konzept für den Neural-Network-Synthesizer entstand aus einer gemeinsamen Arbeit, die 1989 in Berkeley begann, wo David mit der Merce Cunningham Dance Company auftrat. Ich hörte von der ersten Reihe aus zu, wie David sich zwischen zusammengeschalteten elektronischen Geräten bewegte, die zwei Tische füllten. Er erzeugte einen Strom bemerkenswerter Klänge, überlagerte sie, filterte sie und speiste sie in sich selbst zurück, bis der Strom zu einem Fluss wurde. Seine Aufmerksamkeit wanderte von Gerät zu Gerät, er probierte und justierte die Klangmischung wie ein Koch, der eine feine Sauce aus den aromatischsten Zutaten komponiert. Ich war wie gebannt. In der Pause schlug ich ihm vor, ein Computersystem zu entwickeln, das in der Lage ist, die Klänge seiner Darbietungen zu erfassen und zu integrieren.

[…]

Die Entfaltung unserer Ideen war ein Abenteuer der Entdeckung und wie alle echten Abenteuer führte es an unerwartete Orte. Was als Versuch begann, die Vielzahl elektronischer Geräte in Davids Arbeitsumgebung zu integrieren, endete mit der Hinzufügung noch eines weiteren Geräts. In einer frühen Phase untersuchten Ron Clapman von den Bell Labs und ich Designs, die Telefonanlagen und Stift-Bildschirm-Schnittstellen verwendeten, um eine Breitband-Matrix von analogen und digitalen Signalen zu schalten, darunter nicht nur Audio-, sondern auch Video- und Aufführungssaal-Steuersignale. Das brachte uns dazu, über parallele Prozessoren mit umfangreichen Rückkopplungspfaden nachzudenken.

1990 nahm das Projekt eine grundlegende Wendung, als ich Mark Holler von Intel auf einer Computerarchitekturkonferenz in der Nähe von Carmel, Kalifornien, traf. Mark stellte einen neuen analogen Mikrochip für neuronale Netze vor, dessen Design er kürzlich geleitet hatte. Der Chip emuliert elektronisch die Neuronenzellen in unserem Gehirn und kann viele analoge Signale parallel verarbeiten. Er schien eine perfekte Basis für einen Audiosignal-Router zu sein, also sprach ich Mark bei einem Spaziergang am Strand der Pazifikküste auf die Idee an. Er war der Meinung, dass es funktionieren könnte, bot mir einen Chip zum Experimentieren an, und wir schlossen sofort Freundschaft. Bald darauf stieß ein weiterer Kollege, Mark Thorson, zu uns, um das erste Hardware-Design für das auszuarbeiten, was nicht nur ein Signal-Router, sondern auch der analoge Audio-Synthesizer werden sollte, den David in dieser Performance verwendet. Während unserer gesamten Forschungs- und Entwicklungsarbeit war David ein Leitstern. Seine künstlerische Intuition und seine Erfahrung mit elektronischer Performance halfen, unser Denken bei jedem Schritt zu formen.

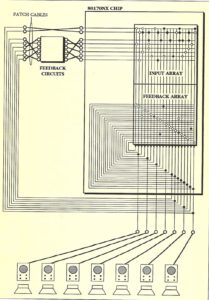

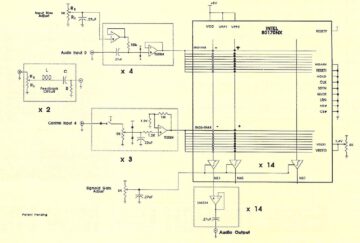

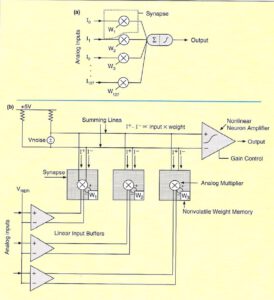

Der Neuronennetz-Chip bildet das Herzstück des Synthesizers. Er besteht aus 64 nichtlinearen Verstärkern (den elektronischen Neuronen auf dem Chip) mit 10240 programmierbaren Verbindungen. Jedes Eingangssignal kann mit jedem Neuron verbunden werden, dessen Ausgang über On-Chip- oder Off-Chip-Pfade, jeweils mit variabler Verbindungsstärke, zu jedem Eingang zurückgeführt werden kann. Die gleichen Floating-Gate-Bausteine, die in EEPROMs (elektrisch löschbare, programmierbare Festwertspeicher) verwendet werden, werden in einer analogen Betriebsart eingesetzt, um die Stärken der Verbindungen zu speichern. Der Synthesizer fügt R-C (Widerstand-Kapazität)-Tankschaltungen auf den Rückkopplungspfaden für 16 der 64 Neuronen hinzu, um die Schwingungsfrequenzen zu steuern. Die R-C-Schaltungen erzeugen Relaxationsschwingungen. Durch das Zusammenschalten vieler Relaxationsoszillatoren werden schnell komplexe Klänge erzeugt. Globale Verstärkungs- und Vorspannungssignale auf dem Chip steuern die relativen Amplituden der Neuronenschwingungen. In der Nähe des Beginns der Oszillation sind die Neuronen empfindlich für inhärentes thermisches Rauschen, das durch zufällige Bewegungen von Elektronengruppen, die sich durch das monolithische Siliziumgitter bewegen, erzeugt wird. Dieses thermische Rauschen fügt den Ausgängen des Synthesizers Unvorhersehbarkeit hinzu, etwas, das David besonders reizvoll fand.

Die Steuerkonsole des Synthesizers regelt den Neural-Network-Chip, die R-C-Schaltungen, die externen Rückkopplungswege und die Ausgangskanäle. Der Chip selbst wird in diesem ersten Synthesizer nicht in vollem Umfang genutzt. Er erzeugt Klänge und leitet Signale weiter, aber die Rolle des Lernenden, des Mustererkenners und des Antwortenden wird von David übernommen, der selbst ein weitaus komplexeres neuronales Netzwerk ist als der Chip. Während der Aufführung wählt David aus bis zu 14 Kanälen des Synthesizer-Ausgangs aus und modifiziert jeden von ihnen mit seinen anderen elektronischen Geräten, um die endgültigen Signale zu erzeugen. Er debütierte den Synthesizer an der Pariser Oper (Garnier) im November 1992 bei Aufführungen von Enter mit der Merce Cunningham Dance Company. In der Aufnahme von 1994 für diese CD, die während späterer Experimente mit dem Synthesizer in Banff entstand, sind vier diskrete Kanäle, die 12 aufgenommene Spuren repräsentieren, zu Stereo gemischt.

Audio-Oszillatoren haben eine subtile, aber lange Geschichte im Silicon Valley. Viele örtliche Ingenieure datieren den Beginn der Halbleiterindustrie auf die Entwicklung ihres ersten Produkts, eines Audio-Oszillators, durch Bill Hewlett und David Packard im Jahr 1938 in einer Garage in der Innenstadt von Palo Alto, nur wenige Blocks von dem Studio entfernt, in dem dieser Synthesizer gebaut wurde. Unsere Arbeit in den Jahren 1993 und 1994 mit David Tudor führte zur Entwicklung, hauptsächlich durch Mark Holler, eines Synthesizers der zweiten Generation, der auf mehreren Chips mit neuronalen Netzwerken basiert. Es handelt sich um ein hybrides System, das die analogen Neuronennetz-Chips zur Erzeugung von Audiowellenformen und einen kleinen digitalen Computer zur Steuerung der Neuronenverbindungen verwendet. Die analogen Wellenformen haben Frequenzkomponenten von bis zu 100kHz und sind viel komplexer, als sie von einem digitalen Computer in Echtzeit erzeugt werden können. Der Performer benutzt den Computer, um Zehntausende von Interneuronenverbindungen während der Performance zu verändern. Der Raum möglicher Interneuronenkonfigurationen ist so groß, dass es schwierig ist, das Verhalten des Synthesizers zu reproduzieren, der den Klang mit der Zeit selbst entwickeln kann. Die Suche nach den Bereichen der Konfigurationen, die einen fesselnden Klang erzeugen, wird zur Herausforderung. Es ist möglich, dass bei weiterer Entwicklung der Computer bei der Suche nach diesen Regionen hilfreich sein kann. Bis dahin gibt es keinen Ersatz für David.

[…]“

Der Chip

Der hier verwendete Chip ist der Intel 80170NX Neural Processor alias ETANN. ETANN (Electronically Trainable Analog Neural Network) war einer der ersten kommerziellen neuronalen Prozessoren, der von Intel um 1989 eingeführt wurde. Dieser Chip wurde auf einem 1,0-µm-Prozess implementiert und enthielt 64 analoge Neuronen und 10.240 analoge Synapsen. Der ETANN ist auch der erste kommerzielle analoge neuronale Prozessor und gilt als der erste erfolgreiche kommerzielle neuronale Netzwerkchip.

Im Jahr 1993 schrieb Forest Warthman einen Artikel über den Synthesizer in Dr. Dobbs Journal, der hier als pdf zu lesen ist: Dr. Dobbs – A Neural-Network Audio Synthesizer.

Software-defined analog

Ich denke, es könnte ein interessanter Ansatz sein, zu versuchen, diese frühen analogen neuronalen Netze auf moderner software-definierter analoger Hardware wie dieser von znra nachzubauen und weiterzuentwickeln.

P.S.: das Beitragsbild wurde mit einem KI-Dienst, letsenhance.io, hochskaliert. Es ist schön, wie es Spock Ohren zu David Tudor hinzugerendert hat.